Goose rend l’agent ia de code accessible sans abonnement

L’agent ia de codage devient vite une ligne de coût fixe, avec des abonnements par développeur et des limites d’usage. Dans les faits, Goose change la donne : l’outil est gratuit, fonctionne en local et laisse le choix du modèle, ce qui réduit aussi le risque de verrouillage fournisseur.

Quand l’ia de codage se transforme en facture mensuelle

Les assistants et agents de codage se multiplient, mais beaucoup reprennent le même schéma : abonnement, quotas et dépendance à un service en ligne. Claude Code illustre bien cette logique, avec des paliers annoncés autour de 20 à 200 dollars par mois selon le niveau d’usage, et des limites de débit côté produit (détails compilés par la presse spécialisée et retours utilisateurs) ( comparatif Goose vs Claude Code ).

Pour une PME, l’addition grimpe vite dès qu’on équipe plusieurs postes. Et ce n’est pas qu’une question de budget : certaines équipes veulent garder du code et des données sensibles sur la machine, ou continuer à travailler avec une connexion instable.

Dans ce contexte, le positionnement se clarifie. Claude Code est un produit intégré, souvent très abouti côté expérience, mais fermé sur son écosystème de modèles. Goose se présente plutôt comme une plateforme d’agent, « local-first » (d’abord en local), et agnostique sur le modèle.

Goose en clair : un agent, pas un modèle

Goose est un agent IA open source publié par Block sous licence Apache 2.0, avec une application de bureau et une interface en ligne de commande (CLI) ( dépôt GitHub du projet, documentation de démarrage ). Concrètement, il peut lire et modifier des fichiers, exécuter des commandes, et enchaîner des actions sur un projet comme le ferait un membre de l’équipe.

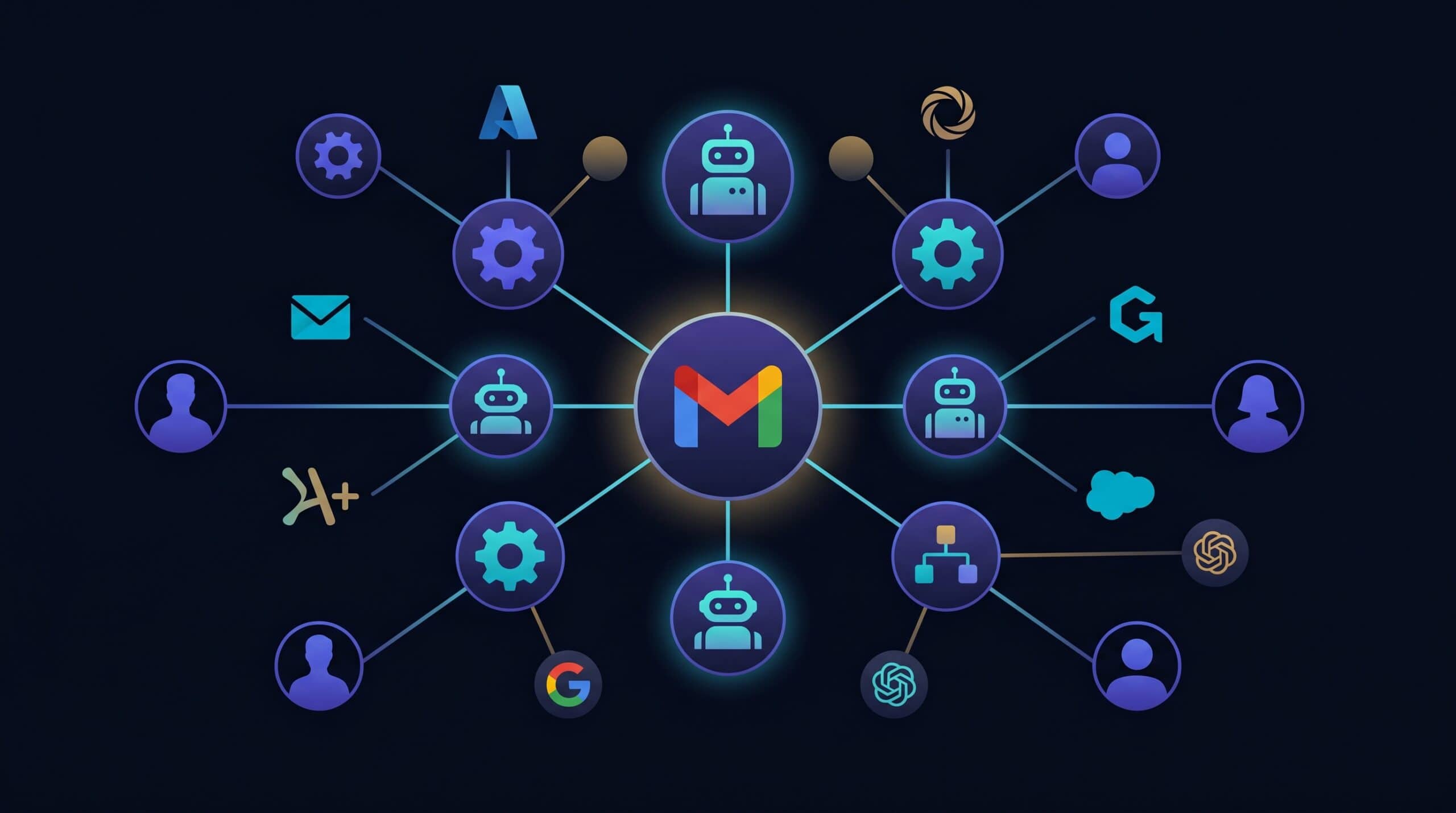

La brique clé est le protocole de contexte de modèle (MCP), un standard ouvert pour brancher des « outils » à un agent : dépôt de code, messagerie, bases de données, services internes, etc. Goose s’en sert comme système d’extensions, plutôt que d’enfermer les intégrations dans un cadre propriétaire ( présentation de l’extension system et MCP, retour Block sur MCP en entreprise ).

L’autre idée utile à comprendre, ce sont les « recettes » : des procédures rejouables, partageables, qu’on peut exécuter à la demande, programmées ou en chaîne dans une intégration continue. Elles peuvent aussi s’appuyer sur des sous-recettes parallélisées, pour traiter plusieurs tâches indépendantes sans attendre la fin de chacune ( recettes de session, sous-recettes en parallèle ).

Point important : Goose n’est pas un grand modèle de langage (LLM). C’est un orchestrateur, et la qualité finale dépend du LLM choisi, en ligne via une clé d’API ou en local.

Goose vs Claude Code : cinq axes qui comptent vraiment

Sur le terrain, la comparaison utile ne se joue pas sur une « meilleure IA » abstraite. Elle se joue sur des arbitrages opérationnels.

D’abord, le coût. Claude Code repose sur un abonnement, avec des paliers et des limites d’usage, tandis que Goose est gratuit et facture seulement le modèle que vous branchez, ou rien si vous utilisez un modèle local ( comparatif chiffré et implications coûts ).

Ensuite, le déploiement. Claude Code est « cloud-first » (d’abord dans le nuage), ce qui peut simplifier le démarrage, mais impose un passage réseau. Goose est « local-first », ce qui aide pour la latence, l’usage hors-ligne partiel, et certains cas de confidentialité (à cadrer selon vos politiques internes) ( installation et fonctionnement ).

Troisième point, le verrouillage fournisseur. Claude Code est lié à un fournisseur de modèles, alors que Goose peut basculer entre plusieurs options, y compris des exécutions locales via Ollama (moteur local pour exécuter des modèles) ( Goose avec Ollama ).

Quatrième axe, l’extensibilité. Claude Code propose des intégrations dans le cadre de son produit. Goose s’appuie sur MCP, ce qui facilite la création de serveurs internes, et la réutilisation d’intégrations compatibles dans d’autres clients MCP.

Enfin, l’expérience et la maturité. Claude Code est souvent plus « poli » côté interface et parcours. Goose est très modulable, mais peut refléter les réalités d’un projet open source : documentation ou ergonomie parfois inégales selon les fonctionnalités ( dépôt GitHub et activité ).

Tester Goose en 30 minutes, sans se raconter d’histoires

Le plus efficace est de traiter Goose comme un essai comparatif, avec des tâches courtes et mesurables.

Côté prérequis, il vous faut une machine de développement et, soit une clé d’interface de programmation d’application (API) pour un fournisseur de modèles, soit un modèle local via Ollama. En pratique, commencez par l’application de bureau si votre équipe n’aime pas la ligne de commande, ou par la CLI si vous visez l’automatisation.

L’installation est documentée sur macOS, Windows et Linux, puis vient le choix du fournisseur et la première session ( guide officiel de démarrage, liste des fournisseurs supportés ).

Pour un test rapide, trois scénarios donnent des signaux fiables.

Le premier : revue de demande de fusion (PR), puis proposition de correctif sous forme de patch. Demandez un diagnostic, une liste d’hypothèses, puis une modification minimale.

Le deuxième : génération ou renforcement de tests, puis exécution des commandes de test. L’objectif n’est pas de « tout tester », mais d’obtenir un filet de sécurité utile en moins d’une heure.

Le troisième : automatisation multi-outils via MCP, par exemple créer un ticket, mettre à jour un fichier de notes de version, et notifier une équipe sur une messagerie interne.

Mesurez quatre éléments simples : temps gagné, coût estimé en jetons si vous passez par API, taux de retravail (combien de corrections humaines), et niveau de confiance avant d’autoriser des actions système.

Des cas d’usage qui paient vraiment en équipe

Pour les équipes de développement, Goose est pertinent sur les migrations et refontes, la documentation, l’augmentation de couverture de tests, ou des tâches de diagnostic répétitives. Block cite des usages internes sur des migrations et automatisations, avec une adoption hebdomadaire large et des gains de productivité déclarés, à interpréter avec prudence car ce sont des chiffres d’entreprise ( retours d’usage et cas pratiques ).

Pour les équipes d’exploitation et données, l’intérêt est souvent plus immédiat : exécuter un « runbook » (procédure d’exploitation), produire un rapport récurrent, trier un incident, ou interroger plusieurs systèmes via des extensions. C’est ici que les recettes deviennent un actif partagé : on industrialise une procédure, puis on la rejoue.

Exemple 1 : un incident récurrent de performance sur une application interne → recette qui collecte journaux, extrait les indicateurs, propose une hypothèse → diagnostic produit en minutes au lieu d’une demi-heure.

Exemple 2 : une mise en conformité documentaire → recette qui compare deux versions, liste les écarts, et prépare une synthèse actionnable → moins d’allers-retours et une traçabilité améliorée.

Exemple 3 : une livraison hebdomadaire → recette qui génère une note de version à partir des tickets et commits, puis ouvre une demande de relecture → temps de coordination réduit, qualité plus homogène.

Les limites à poser avant l’emballement

La première limite est la qualité du LLM choisi. Si vous branchez un modèle moins performant, Goose ne compensera pas tout, et Claude reste souvent très fort sur les tâches de codage complexes.

Deuxième limite, la sécurité. MCP ouvre l’accès à des outils puissants, donc à une surface de risque : droits excessifs, fuite de secrets, ou actions non désirées. En entreprise, cela appelle une gouvernance : liste d’extensions approuvées, gestion stricte des secrets, journalisation et contrôle d’accès basé sur les rôles (RBAC).

Troisième point, le local. Les modèles « on-device » (sur l’appareil) demandent des ressources, et toutes les machines ne suivront pas. Si vous restez en API, vous retrouvez une dépendance classique au réseau et au fournisseur.

Enfin, la maintenance. Avec l’open source, il faut figer des versions, versionner les recettes, et éviter que chacun « bricole » des automatismes différents sans contrôle.

Quel choix pour quel contexte, sans dogme

Pour un indépendant ou une PME sensible au budget, Goose est souvent un bon point d’entrée, avec un modèle choisi selon le rapport coût/qualité. Pour une entreprise avec exigences de conformité, Goose devient intéressant si vous investissez dans la gouvernance MCP et des modèles autorisés.

Si votre priorité est le meilleur résultat immédiat et une expérience très guidée, Claude Code peut rester plus confortable. Une voie intermédiaire consiste à utiliser Goose avec un modèle Claude, afin de garder l’orchestration et limiter le verrouillage.

Si votre besoin principal est une intégration très poussée à l’atelier de développement, des outils spécialisés comme Cursor peuvent être plus adaptés, au prix d’autres compromis.

Goose n’est pas seulement une option gratuite. C’est une bascule vers une couche d’orchestration standardisée, qui redonne du pouvoir aux équipes et remet la facture sous contrôle. Le test individuel est accessible, mais le passage à l’échelle exige une discipline sur la sécurité, les recettes et le choix des modèles.