Chatgpt ouvre la porte à la publicité, et les entreprises doivent s’adapter

La publicité dans chatgpt marque un tournant de modèle économique, et ce n’est pas juste un bandeau en plus. Pour les entreprises, l’enjeu touche à la confiance, aux données et aux usages quotidiens.

Ce qui se joue, c’est la capacité à garder chatgpt utile au travail, sans laisser la monétisation brouiller l’expérience. Et à mettre les bons réglages avant que les habitudes internes ne se figent.

Ce qui est annoncé, exactement

OpenAI a annoncé le lancement de tests publicitaires dans ChatGPT pour certains utilisateurs. Dans les faits, le dispositif vise les comptes ChatGPT gratuit et ChatGPT Go, uniquement aux États-Unis, et pour les personnes de 18 ans et plus, tandis que les offres payantes supérieures restent sans publicité selon OpenAI ( page d’aide officielle ).

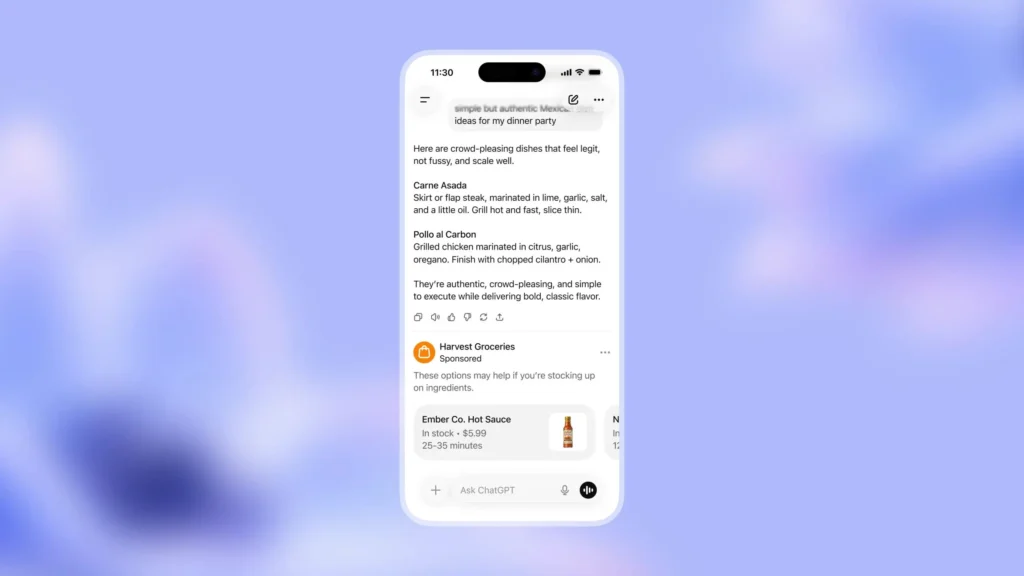

Où s’affichent ces publicités ? OpenAI indique qu’elles apparaîtront en bas des réponses, séparées visuellement du texte généré, avec un marquage explicite « sponsorisé » ( présentation de l’approche publicitaire ). L’objectif affiché est d’éviter la confusion entre conseil et message commercial.

À quoi ressemblent-elles ? Le format décrit est celui de suggestions contextuelles, liées au sujet de la conversation. Exemple souvent cité : une discussion sur un voyage peut déclencher une offre d’hôtel, avec parfois un bouton d’action (contacter l’annonceur dans le chat) comme le relatent des médias spécialisés ( synthèse BDM ).

Enfin, OpenAI met en avant plusieurs garde-fous. L’entreprise affirme que les publicités ne doivent pas influencer la réponse du modèle, et que certains thèmes sont exclus (politique, santé, santé mentale) selon la documentation et les communications publiques ( page d’aide officielle, approche OpenAI ). Les utilisateurs disposeraient aussi de contrôles : désactiver la personnalisation des annonces, masquer une publicité, et effacer des données utilisées pour la publicité.

L’équation économique qui pousse OpenAI à franchir le pas

Faire tourner un assistant conversationnel à grande échelle coûte cher, même quand l’utilisateur ne paie pas. En pratique, chaque requête déclenche des calculs sur des serveurs, et ces coûts augmentent avec le volume.

Dans ce contexte, OpenAI organise une logique « deux vitesses ». D’un côté, un accès gratuit ou peu cher, subventionné par la publicité. De l’autre, des abonnements plus protecteurs, sans publicités, qui servent de référence pour les usages exigeants.

L’entreprise prépare aussi une diversification de revenus. Des projections de revenus publicitaires à horizon 2026 ont été rapportées par la presse économique, en lien avec l’industrialisation de ce chantier ( Business Insider ). Les montants restent des objectifs, pas des résultats.

Signe que le mouvement est structurel, OpenAI a renforcé son équipe avec des profils issus de grandes plateformes publicitaires, d’après plusieurs enquêtes et analyses. Dit autrement : la publicité n’est pas présentée comme un simple test d’interface, mais comme une brique stratégique de financement.

Une nouvelle expérience utilisateur, donc une nouvelle question de confiance

Dans l’usage, la réponse de chatgpt risque d’être perçue comme un ensemble en trois blocs. Il y a le texte généré, puis l’espace publicitaire, puis un appel à l’action, parfois cliquable.

Même avec un label « sponsorisé », la confusion peut exister. Un assistant conversationnel ressemble à un conseiller, plus qu’à un moteur de recherche classique, et l’utilisateur baisse souvent sa vigilance au fil des échanges.

Point important pour les managers : l’influence ne passe pas forcément par une « réponse truquée ». Une publicité peut orienter un parcours décisionnel par effet d’ancrage, ou par choix par défaut, simplement parce qu’elle apparaît au bon moment.

Risque plus subtil : l’économie de la publicité récompense les sujets « monétisables ». Sans changer les faits, une interface peut pousser à cadrer les options autour de catégories rentables, ce qui suffit à modifier des arbitrages.

Confidentialité : ce qui est promis, et ce que l’entreprise doit présumer

OpenAI affirme ne pas revendre les conversations et ne pas les partager avec les annonceurs, sauf si l’utilisateur choisit d’interagir directement avec eux. C’est une ligne importante, réaffirmée dans son approche et sa documentation ( approche OpenAI, page d’aide officielle ).

Toutefois, côté organisation, un chat révèle plus qu’une requête isolée. Il contient des intentions, des contraintes internes, des noms de clients, parfois des éléments de stratégie, et cela peut constituer une exposition indirecte.

Il faut aussi distinguer deux débats. Le premier est le ciblage, c’est-à-dire la personnalisation de publicités en fonction du profil. Le second est l’intégrité des réponses, c’est-à-dire l’indépendance du contenu généré vis-à-vis des intérêts commerciaux.

Enfin, même avec des promesses fortes, une entreprise doit présumer l’existence de traces techniques. Comme le rappellent des guides de bonnes pratiques, des journaux d’usage peuvent être conservés pour la lutte contre l’abus ou des obligations légales, ce qui impose de traiter l’outil comme potentiellement exposable ( guide confidentialité ).

Offres pro : une ligne claire, mais des décisions à prendre en interne

OpenAI indique que les offres ChatGPT Plus, Pro, Business et Enterprise restent sans publicité, contrairement aux versions ChatGPT gratuit et ChatGPT Go ( page d’aide officielle ). Pour une direction marketing ou une DSI, ce point simplifie la lecture.

Le vrai risque opérationnel vient des usages « hors cadre ». Si une équipe travaille sur la version gratuite ou Go, elle s’expose à des publicités, à des réglages plus variables, et à une gouvernance faible.

Dans les faits, la décision est moins technique que politique. Soit l’entreprise standardise une offre payante pour les usages professionnels, soit elle accepte une hétérogénéité difficile à auditer.

Pour les équipes, certains contrôles valent une vérification immédiate : historique activé ou non, discussion temporaire (« temporary chat ») comme mode de session non conservée, personnalisation publicitaire désactivable, et options d’administration quand elles existent.

Bonnes pratiques « dès maintenant » pour continuer à utiliser chatgpt en interne

Les entreprises peuvent réduire le risque sans renoncer à la productivité. L’idée est de garder l’outil dans une zone d’usage compatible avec la confidentialité, puis de vérifier ce qui compte.

Points de vigilance :

- Interdire les données sensibles : secrets d’affaires, données personnelles, contrats, informations clients identifiantes.

- Anonymiser les demandes : remplacer les noms par des variables, et synthétiser le contexte au lieu de le copier.

- Séparer idéation et décision : l’IA propose, un humain arbitre avec des sources vérifiées.

- Trianguler les réponses sensibles : recouper via des sources externes et, si besoin, une autre IA.

- Former les équipes : reconnaître « sponsorisé », documenter les choix, et signaler les dérives.

2026, année charnière : normalisation et surveillance réglementaire

La publicité dans les assistants conversationnels n’arrive pas dans un vide. Google, Meta et d’autres acteurs testent aussi des formats sponsorisés, ce qui banalise l’idée d’une interface « assistant + commerce ».

En Europe, la surveillance va monter. L’Autorité de la concurrence a annoncé une enquête sectorielle sur les agents conversationnels, avec une opinion attendue en 2026, ce qui place la publicité et la discrimination d’accès au cœur du débat ( communiqué de l’Autorité ).

Dans ce contexte, la conformité au Règlement général sur la protection des données (RGPD) devient plus sensible, car la publicité implique souvent du profilage. La Commission nationale de l’informatique et des libertés (CNIL) rappelle aussi le cadre du règlement européen sur l’IA, qui renforce les exigences de transparence pour certains systèmes ( point CNIL ).

Conclusion

La publicité est un levier de soutenabilité économique, mais elle déplace chatgpt. L’outil de productivité se rapproche d’une interface de marché, avec une tension durable entre utilité et monétisation.

Pour un usage professionnel, la ligne est assez tranchée : éviter ChatGPT gratuit et ChatGPT Go au travail, formaliser une politique interne, et privilégier une offre payante avec gouvernance et formation. Enfin, traiter l’IA comme un fournisseur critique, à auditer régulièrement sur les coûts, les biais et la conformité.