GPT-5.5 double son prix : OpenAI parie sur le long contexte

Cinq dollars le million de tokens en entrée, trente en sortie. La grille tarifaire de GPT-5.5, publiée le 24 avril par OpenAI, double celle de GPT-5.4. À contre-courant d’un marché où les prix des grands modèles ont chuté de 80 % en deux ans, l’éditeur revendique une « nouvelle classe d’intelligence » qui justifierait l’écart. La question n’est plus de savoir si le modèle est meilleur — il l’est sur certaines tâches — mais sur lesquelles il mérite son surcoût, et lesquelles peuvent rester sur la version précédente.

OpenAI inverse la tendance baissière du marché

Le doublement du tarif tranche avec deux ans d’érosion continue. Là où GPT-5.4 facturait 2,50 dollars en entrée et 15 en sortie, GPT-5.5 monte à 5 et 30 dollars. La variante Pro, dédiée aux raisonnements longs, affiche 30 dollars en entrée et 180 en sortie, soit douze fois le tarif de GPT-5.4 standard. OpenAI ajoute une surcharge automatique au-delà de 272 000 tokens d’entrée : prix doublé sur l’input et majoré de 50 % sur l’output, pour toute la session. Le cache, lui, reste compétitif à 50 centimes le million de tokens, et les modes Batch et Flex divisent encore le tarif par deux.

Ce positionnement haut de gamme assume une bascule. OpenAI ne cherche plus à courir le ticket d’entrée le moins cher — segment où DeepSeek V4-Pro et les modèles open-weight dominent désormais. Le pari : capter les usages où le surcoût est absorbable parce que le gain de qualité change la nature du livrable. Reste à savoir lesquels.

Le million de tokens devient enfin utilisable

La nouveauté la plus tangible n’est pas dans les benchmarks de raisonnement, mais dans la capacité du modèle à exploiter sa propre fenêtre de contexte. Sur le test MRCR v2, qui mesure la précision de récupération multi-aiguilles dans un contexte de 512K à 1M de tokens, GPT-5.5 atteint 74 % contre 36,6 % pour GPT-5.4. Le bond de plus de trente-sept points fait basculer le 1M-token d’argument commercial à fonctionnalité opérationnelle.

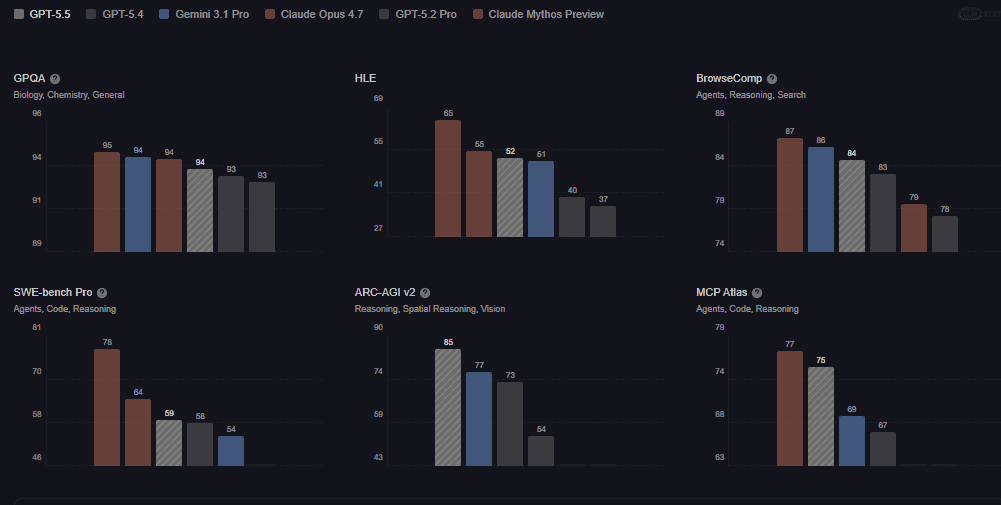

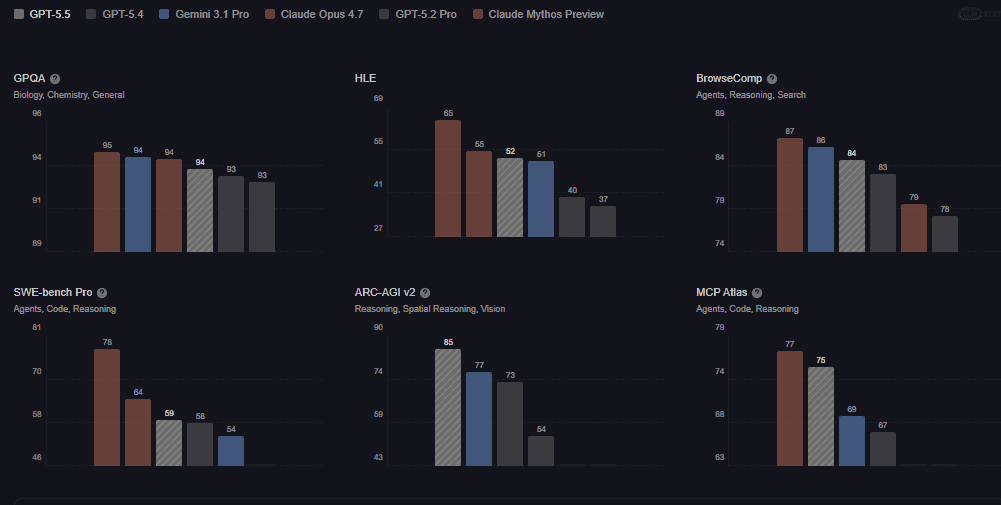

Pour un cabinet d’avocats qui veut interroger trois mille pages de contrats sans perdre les références croisées, ou pour un responsable produit qui consolide six mois de tickets support, l’écart est concret. Le modèle ne se contente plus d’avoir un grand contexte, il le restitue. Sur Terminal-Bench 2.0, qui évalue l’enchaînement de commandes shell complexes, GPT-5.5 grimpe à 82,7 %, devant Claude Opus 4.7 à 69,4 %. Sur FrontierMath, 51,7 % contre 43,8 % pour son concurrent direct. Là où le besoin combine raisonnement long et précision, la facture supplémentaire trouve sa contrepartie.

Claude garde l’avantage sur le code de production

Le tableau s’inverse dès qu’on bascule du laboratoire au dépôt Git. Sur SWE-Bench Pro, qui teste la résolution de tickets GitHub réels, Claude Opus 4.7 conserve l’avantage avec 64,3 % de réussite, contre 58,6 % pour GPT-5.5. L’écart de cinq points et demi sur la tâche la plus représentative du travail de développement quotidien limite l’argument du leadership absolu.

OpenAI met en avant les progrès de GPT-5.5 sur la génération de code en autonomie et l’usage d’un terminal sans supervision. Anthropic, de son côté, a optimisé Opus 4.7 sur la réparation de bugs, la refonte de grande base de code, la lecture de contextes Git existants. Les deux philosophies ne ciblent pas la même chose. Une équipe qui pilote des agents développeurs sur des projets neufs trouvera GPT-5.5 séduisant. Une équipe qui maintient une base existante depuis trois ans n’a aucune raison de migrer.

Quand GPT-5.5 mérite son surcoût, et quand 5.4 suffit

L’arbitrage se ramène à trois questions. La première porte sur le volume de contexte effectif. Si les prompts dépassent rarement 100 000 tokens, le gain MRCR ne change rien à la facture. GPT-5.4 reste deux fois moins cher pour un résultat équivalent. La seconde concerne le ratio entrée/sortie. Avec une sortie majorée à trente dollars, les générations longues — rédaction de rapports, synthèses détaillées — voient leur coût exploser plus vite que sur les tâches courtes type extraction structurée.

La troisième question est celle de la concurrence directe. Sur le code de production, Claude Opus 4.7 reste devant à un tarif comparable. Sur le raisonnement long et la math, GPT-5.5 prend l’avantage mais Gemini 3.1 talonne, et son intégration Google Workspace pèse pour les organisations déjà sous environnement Google. Le choix se fait usage par usage, pas vendor par vendor. Tester GPT-5.5 sur deux ou trois cas concrets et mesurer le delta de qualité contre le surcoût reste la seule méthode défendable. Une organisation qui bascule l’ensemble de son trafic sur la nouvelle version sans cet exercice paiera deux fois ce qu’elle aurait pu, pour des tâches qui ne le nécessitent pas.