Découvrez le Phi-3-Mini, le petit géant de Microsoft

Bienvenue dans l’ère des modèles de langage artificiel compact et performant ! Le Phi-3-Mini de Microsoft, sujet de notre exploration aujourd’hui, marque une étape révolutionnaire dans le domaine des technologies d’intelligence artificielle. Ce petit modèle de langage de grande puissance est conçu pour fonctionner efficacement sur des plateformes mobiles, tout en offrant des capacités comparables aux plus grands modèles existants. Dans cet article, nous allons détailler ce qu’est le Phi-3-Mini, ses fonctionnalités, avantages et les perspectives qu’il ouvre pour les utilisateurs et développeurs. Découvrons comment Microsoft a réussi à miniaturiser la puissance de l’IA tout en conservant une performance exceptionnelle, posant ainsi les bases de ce que pourrait être l’avenir des technologies portables.

Exploration du Phi-3-Mini, la révolution compacte de Microsoft

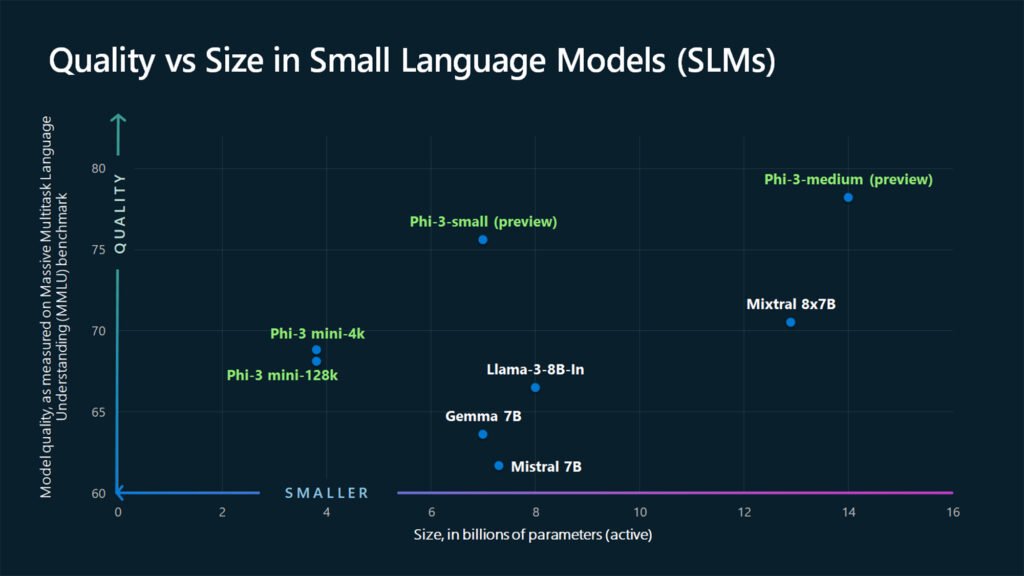

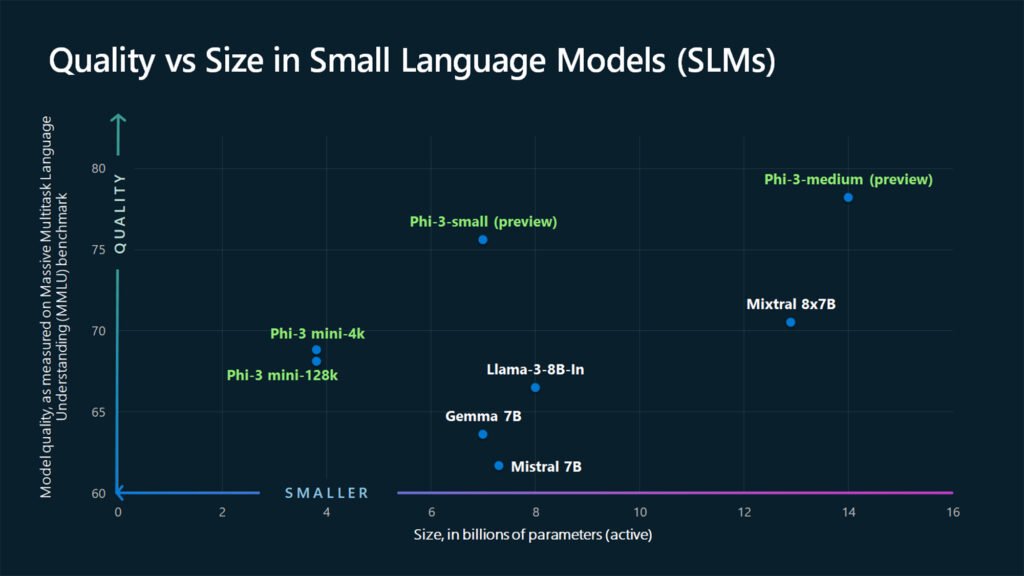

Le Phi-3-Mini est une avancée significative dans le domaine des modèles de langage de Microsoft, conçu pour offrir une solution compacte mais extrêmement performante. Ce modèle de langage de petite taille est le fruit de recherches approfondies visant à réduire la consommation d’énergie et l’espace de stockage nécessaire, sans compromettre la qualité des résultats générés. La prouesse ici réside dans la capacité de Microsoft à comprimer la technologie des grands modèles linguistiques dans un format qui peut non seulement fonctionner sur des serveurs de moindre puissance mais aussi sur des appareils mobiles.

Développement et objectifs stratégiques

Microsoft a développé Phi-3-Mini dans le but de rendre les technologies d’intelligence artificielle plus accessibles et utilisables dans des contextes quotidiens. Avec l’augmentation de l’utilisation des appareils mobiles pour des tâches complexes, il est devenu impératif de disposer d’un modèle capable de fonctionner dans des environnements à ressources limitées. Cette version mini vise ainsi à démocratiser l’accès aux technologies avancées d’IA, permettant une intégration fluide dans des applications mobiles sans la nécessité d’une connexion constante à des serveurs distants.

Performances et capacités innovantes du Mini modèle

Grâce à des innovations en matière d’algorithmes et de compression des données, ce SML peut exécuter des tâches de traitement du langage naturel avec une efficacité équivalente à celle des modèles beaucoup plus grands. Il est optimisé pour des opérations à faible latence, ce qui est crucial pour les applications en temps réel sur des appareils mobiles. De plus, sa capacité à fonctionner de manière autonome, sans dépendre constamment de connexions au cloud, en fait un choix idéal pour une multitude d’applications mobiles où la rapidité et l’indépendance sont essentielles.

Avantages et transformations pour l’utilisateur mobile

L’adoption de cette solution dans des applications mobiles représente une véritable révolution pour les utilisateurs finaux. Ce modèle de langage est spécialement conçu pour améliorer l’expérience utilisateur sur des appareils mobiles, grâce à ses capacités de traitement rapide et son indépendance vis-à-vis des infrastructures cloud lourdes.

Portabilité et accessibilité renforcées

Le Phi-3-Mini démocratise l’accès à des technologies d’intelligence artificielle avancées, les rendant accessibles à un plus large public. Cette accessibilité élargit le potentiel d’utilisation de l’IA dans des domaines variés tels que l’éducation, la santé et le commerce électronique, où les applications peuvent désormais fonctionner de manière autonome sans nécessiter de matériel spécialisé ou des connexions permanentes au cloud. Les utilisateurs bénéficient ainsi d’une plus grande autonomie et d’une expérience utilisateur améliorée, contribuant à une adoption plus large des solutions basées sur l’IA.

Nouvel horizon pour les développeurs d’applications

Le Phi-3-Mini n’est pas seulement une avancée pour les utilisateurs finaux; il représente également une opportunité significative pour les développeurs d’applications mobiles. Ce modèle offre des possibilités étendues pour l’intégration de l’intelligence artificielle dans des applications mobiles, sans les contraintes traditionnelles liées aux modèles de langage de grande taille.

Facilitation de l’innovation et de l’intégration

L’intégration de Phi-3-Mini dans des applications mobiles est facilitée par sa taille réduite et sa consommation optimisée d’énergie. Les développeurs peuvent utiliser ce modèle pour ajouter des fonctionnalités d’IA à leurs applications sans nécessiter de grandes ressources système ou une dépendance constante à des serveurs distants. Cela permet de créer des applications plus réactives et plus efficaces, capables de fonctionner de manière autonome sur l’appareil de l’utilisateur.

L’avenir des technologies compactes et de l’IA

Alors que le Phi-3-Mini continue de révolutionner l’accès et l’utilisation des technologies d’intelligence artificielle, il est essentiel de regarder vers l’avenir pour anticiper les évolutions possibles et les nouvelles opportunités que ce modèle pourrait offrir. Microsoft, déjà à la pointe de l’innovation dans le domaine de l’IA, est susceptible de continuer à développer des technologies qui repoussent les limites de ce que les modèles compacts peuvent accomplir.

Phi-3-Mini, un tournant dans l’IA mobile

Le Phi-3-Mini de Microsoft est plus qu’un simple produit; il est le symbole d’une évolution vers des technologies plus intelligentes, plus petites et plus efficaces. En rendant l’intelligence artificielle accessible sur des appareils mobiles, ce modèle ouvre un monde de possibilités pour les utilisateurs et les développeurs. Alors que nous envisageons l’avenir, le Phi-3-Mini incarne une promesse de progrès continus dans le domaine de l’IA, promettant des innovations qui continueront à façonner notre interaction avec la technologie. Nous vous encourageons à suivre ces développements passionnants et à explorer comment ils pourraient bénéficier à vos propres applications et initiatives technologiques.

Sources :

Microsoft